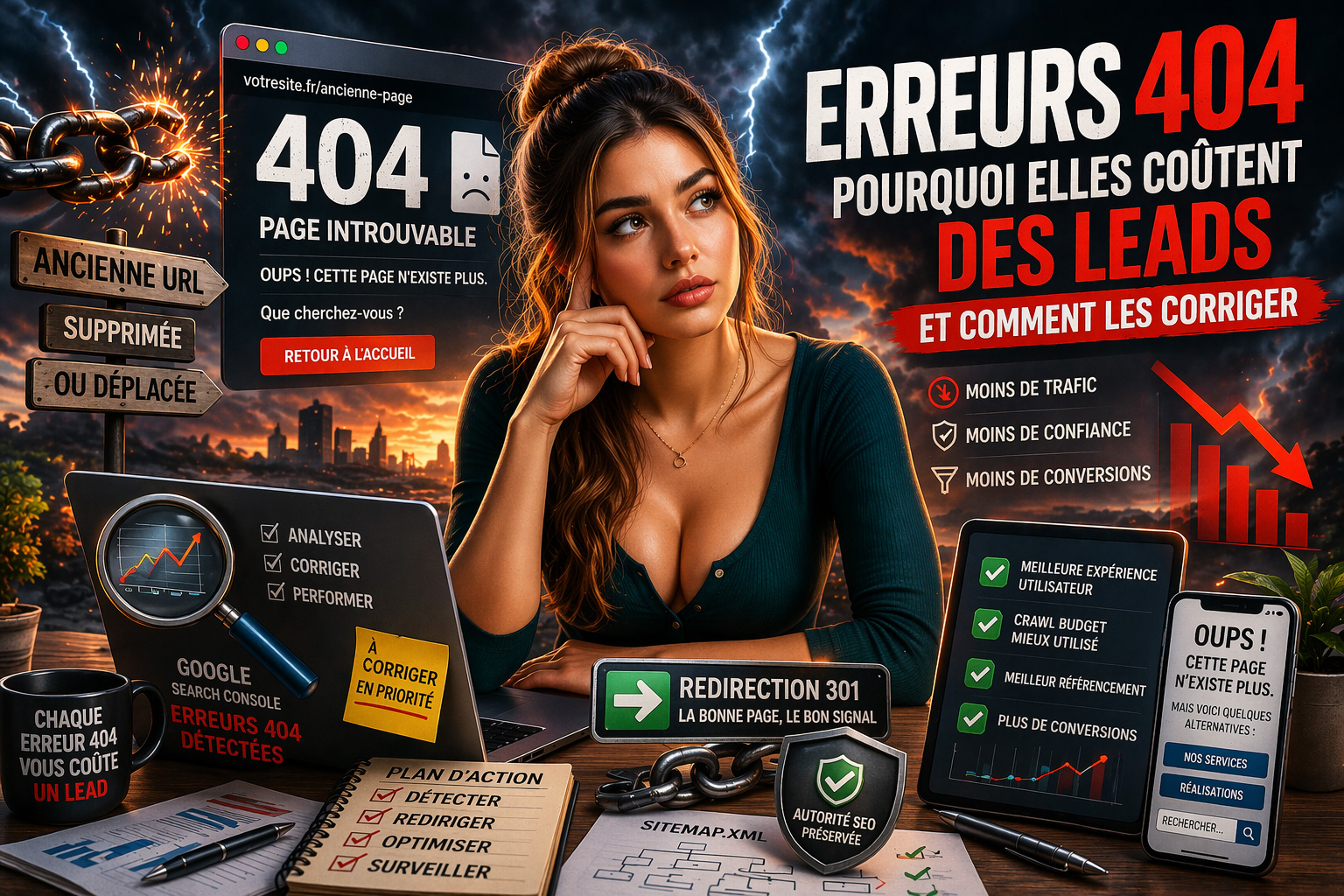

Erreurs 404 sur votre site : pourquoi elles coûtent des leads et comment les corriger

Les erreurs 404 font partie des problèmes techniques les plus courants sur les sites de PME — et paradoxalement, des moins surveillés. Un visiteur qui arrive sur une page d'erreur 404 ne voit pas un message d'alerte qui signale un problème à l'entreprise — il voit simplement une page qui n'existe pas, et dans la grande majorité des cas, il repart immédiatement. Cette invisibilité du problème pour le propriétaire du site, combinée à sa très grande visibilité pour les visiteurs et pour Google, en fait l'un des problèmes techniques dont le coût commercial est le plus systématiquement sous-estimé.

Les erreurs 404 ont deux types de conséquences qui se cumulent : des conséquences directes sur les visiteurs — qui abandonnent le site à l'instant où ils tombent sur une page manquante — et des conséquences indirectes sur le référencement naturel — Google consomme une partie de son budget de crawl sur ces pages sans valeur et peut en tirer des conclusions négatives sur la qualité globale du site. Comprendre ces deux dimensions est le préalable à une décision éclairée sur leur correction et leur prévention.

Avant d'aborder les causes et les solutions, il est utile de comprendre précisément ce qu'est une erreur 404 du point de vue technique et ce qu'elle signifie pour les deux parties les plus concernées — le visiteur humain et Googlebot.

Une erreur 404 est le code HTTP que le serveur renvoie lorsqu'une URL demandée n'existe pas ou n'est plus accessible sur ce serveur. Ce code signifie littéralement "Not Found" — la ressource demandée n'a pas été trouvée. Cette définition technique cache une distinction importante pour le SEO : une page peut renvoyer une erreur 404 parce qu'elle a été délibérément supprimée, parce que son URL a été modifiée sans redirection, parce qu'elle n'a jamais existé (URL tapée incorrectement ou lien mal formé), ou parce qu'une erreur de configuration du serveur empêche son accès.

Cette distinction est importante parce qu'elle conditionne la réponse appropriée. Une page supprimée délibérément parce qu'elle n'est plus pertinente doit être redirigée vers la page la plus thématiquement proche du site — pour préserver l'autorité SEO accumulée et orienter les visiteurs vers un contenu utile. Une URL qui n'a jamais existé et qui génère des erreurs 404 (à cause de liens mal formés dans le code du site) doit être corrigée à la source — en identifiant et en rectifiant les liens incorrects. Ces deux situations ont le même symptôme — une erreur 404 — mais nécessitent des actions correctives différentes. Les raisons pour lesquelles Google ignore certaines pages d'un site incluent précisément ces erreurs 404 non résolues qui signalent un problème de qualité technique.

Lorsque Googlebot visite une URL qui renvoie une erreur 404, il enregistre cette réponse dans son index — en marquant la page comme non disponible. Si cette erreur persiste lors de plusieurs visites successives sur plusieurs semaines, Google retire progressivement l'URL de son index — ce qui signifie que si cette URL avait auparavant un contenu indexé et des positions dans les résultats de recherche, ces positions sont perdues. La désindexation suite à une erreur 404 persistante n'est pas immédiate — Google attend généralement plusieurs semaines avant de considérer une page comme définitivement disparue — mais elle est inévitable si l'erreur n'est pas corrigée.

Ce processus de désindexation progressive est particulièrement préjudiciable pour les pages qui avaient accumulé de l'autorité SEO — des pages qui recevaient des backlinks depuis d'autres sites, qui généraient du trafic organique, ou qui avaient une ancienneté d'indexation significative. Toute cette autorité accumulée est perdue lorsque la page devient une erreur 404 non redirigée — et elle ne sera pas automatiquement transférée vers une autre page du site sans la configuration d'une redirection 301. Cette perte d'autorité est invisible depuis l'interface d'administration du CMS — elle n'est détectable que via les données de Google Search Console ou les outils d'analyse de backlinks.

Googlebot alloue à chaque site un budget de crawl limité — une capacité de visite qui détermine combien de pages peuvent être explorées et indexées dans un intervalle de temps donné. Ce budget est proportionnel à l'autorité et à l'activité éditoriale du site. Lorsqu'une proportion significative de ce budget est consommée par des URLs qui renvoient des erreurs 404 — parce que ces URLs sont référencées dans des liens internes ou dans le sitemap XML du site — ce budget est gaspillé sur des ressources sans valeur, au détriment des pages importantes du site qui sont crawlées moins fréquemment.

Pour les sites de PME dont le budget de crawl est naturellement limité, ce gaspillage peut avoir des effets mesurables sur la fréquence de mise à jour de l'index — les nouvelles pages publiées sont indexées plus lentement, les modifications de contenu sont prises en compte avec du retard dans le classement. Corriger les erreurs 404 en supprimant les URLs problématiques du sitemap et en corrigeant les liens internes cassés est une action d'optimisation technique simple dont l'impact sur l'efficacité du crawl est direct et mesurable dans les données de Search Console.

Les erreurs 404 sur les sites de PME proviennent rarement d'une seule cause — elles résultent généralement d'une accumulation de situations qui se produisent au fil du temps sans que personne ne les surveille systématiquement. Identifier les causes les plus fréquentes permet de cibler efficacement les vérifications à réaliser lors d'un audit.

La refonte de site est la cause la plus massive d'erreurs 404 sur les sites de PME. Lorsqu'une refonte modifie l'architecture du site — en réorganisant les sections, en fusionnant des pages, en modifiant la structure des URLs, ou en changeant de CMS — toutes les anciennes URLs qui ne correspondent plus à une page existante renvoient des erreurs 404. Si ces URLs n'ont pas été redirigées vers les nouvelles pages équivalentes avant ou pendant la mise en ligne de la refonte, l'ensemble de l'autorité SEO accumulée sur les anciennes pages est perdu — et tous les liens externes qui pointaient vers ces anciennes URLs deviennent des liens cassés.

Ce problème est d'autant plus grave que les sites de PME qui font leur première refonte après plusieurs années d'activité ont souvent accumulé un nombre significatif de backlinks et de signaux d'indexation sur leurs anciennes URLs — des signaux qui représentent une valeur SEO réelle qu'une migration bien exécutée aurait préservée. La gestion des redirections lors d'une refonte est l'une des tâches techniques les plus critiques et les plus fréquemment mal exécutées. Les erreurs SEO à éviter lors d'une refonte de site détaillent précisément ce risque de perte de valeur accumulée.

Les liens internes cassés sont une cause d'erreurs 404 plus silencieuse que les refontes — ils s'accumulent progressivement au fil des modifications apportées au site sans refonte complète. Lorsqu'un dirigeant ou un gestionnaire de contenu modifie le slug d'une page existante — pour en améliorer la lisibilité ou la cohérence avec la stratégie éditoriale — tous les liens internes qui pointaient vers l'ancienne URL deviennent instantanément des liens cassés. De même, lorsqu'une page est supprimée depuis l'interface d'administration sans vérification préalable des liens qui y pointaient, ces liens génèrent des erreurs 404 à chaque fois qu'un visiteur ou Googlebot les suit.

Ces liens internes cassés sont particulièrement fréquents dans les sites dont le contenu est géré par plusieurs personnes sans processus de validation centralisé, ou dans les sites dont le menu de navigation a été reorganisé sans mise à jour systématique des liens dans le corps des articles. Un article de blog qui fait référence à une page de service via un lien interne, et dont ce lien devient cassé suite à une modification de l'URL de la page de service, génère une erreur 404 à chaque visite de ce lien — sans que ni le visiteur ni le propriétaire du site ne soit automatiquement alerté. Les implications des URLs et du nom de domaine sur le référencement incluent directement cette gestion des liens internes après modification.

Les liens externes — backlinks depuis d'autres sites, liens partagés sur les réseaux sociaux, liens dans des annuaires professionnels — constituent une troisième source d'erreurs 404 sur laquelle le propriétaire du site a un contrôle limité. Lorsqu'une page vers laquelle pointent des liens externes est supprimée ou dont l'URL est modifiée sans redirection, ces liens externes deviennent des sources d'erreurs 404 — chaque visiteur qui clique sur ces liens arrive sur une page d'erreur plutôt que sur le contenu attendu.

L'impact de ces erreurs 404 générées par des liens externes est double : une perte d'expérience utilisateur pour les visiteurs qui arrivent depuis ces sources, et une perte de valeur SEO pour les backlinks qui transmettaient de l'autorité vers des pages maintenant disparues. La correction passe par la configuration de redirections 301 depuis les anciennes URLs vers les pages actuelles les plus pertinentes — pour récupérer à la fois le trafic et l'autorité SEO qui étaient transmis par ces liens externes. Cette correction est l'une des actions à meilleur retour sur investissement disponibles sur les sites qui ont un historique de backlinks significatif.

Au-delà des conséquences SEO, les erreurs 404 ont des impacts directs et mesurables sur l'expérience des visiteurs et sur le taux de conversion du site — impacts qui peuvent représenter une perte commerciale significative sur les pages à fort trafic.

Un visiteur qui arrive sur une page d'erreur 404 — que ce soit depuis un résultat Google, un lien partagé sur les réseaux sociaux, ou un lien depuis un autre site — se retrouve confronté à une expérience négative et déconcertante. La page 404 standard ne lui offre généralement aucune orientation — pas de menu de navigation, pas de suggestion de page alternative, pas de moteur de recherche interne. Dans la grande majorité des cas, le visiteur quitte immédiatement le site — contribuant ainsi à l'augmentation du taux de rebond et à la réduction du temps moyen sur le site, deux signaux comportementaux que Google peut interpréter défavorablement.

Cette perte de visiteur est particulièrement coûteuse lorsqu'elle se produit sur une URL qui avait auparavant une position significative dans les résultats Google — et qui continue de générer du trafic organique après la disparition de la page, parce que Google n'a pas encore désindexé l'URL. Dans ce cas, le site continue de recevoir des visiteurs qualifiés — qui arrivent avec une intention de contact ou d'achat — et les perd immédiatement à cause d'une erreur 404 non corrigée. Ce scénario est détectable dans Google Analytics — en observant les pages dont le taux de rebond est anormalement élevé et le temps de session est proche de zéro.

Les erreurs 404 affectent également la crédibilité perçue du site — de manière plus diffuse mais tout aussi réelle. Un visiteur qui rencontre plusieurs liens morts en naviguant sur un site perçoit implicitement ce site comme mal entretenu, peu professionnel, ou potentiellement inactif. Cette perception de négligence est particulièrement dommageable pour les secteurs où la confiance est un facteur d'achat central — artisanat, services professionnels, santé, droit. Un prospect qui hésite entre deux prestataires et qui rencontre des liens morts sur le site de l'un d'eux sera naturellement moins enclin à lui faire confiance — même si la qualité de ses services est objectivement supérieure.

Cette perception de négligence est amplifiée lorsque les erreurs 404 se produisent sur des pages stratégiques — la page de contact, une page de réalisation citée dans un article, ou une page de service mentionnée dans une offre commerciale. Ces pages sont celles que les prospects les plus qualifiés sont susceptibles de visiter — et c'est précisément sur ces pages que l'erreur 404 est la plus préjudiciable pour la conversion. L'audit SEO et diagnostic web en Provence identifie systématiquement ces erreurs sur les pages à fort impact commercial.

L'impact des erreurs 404 est structurellement plus sévère sur mobile que sur desktop — pour des raisons comportementales simples. Un utilisateur mobile qui arrive sur une page d'erreur 404 est dans un contexte d'utilisation moins patient que sur desktop — il cherche une information rapidement, souvent en déplacement, parfois avec une connexion instable. Face à une page d'erreur, il ne prendra pas le temps de naviguer vers d'autres sections du site pour trouver l'information qu'il cherchait — il fermera l'onglet et passera à un résultat concurrent dans les résultats Google. Ce comportement d'abandon mobile immédiat est l'un des plus coûteux en termes de leads perdus — parce que la majorité des recherches locales s'effectue depuis un smartphone.

La vérification de l'impact mobile des erreurs 404 peut être réalisée dans Google Analytics GA4 — en segmentant les données par type d'appareil et en identifiant les pages qui présentent un taux de rebond anormalement élevé uniquement sur mobile. Cette segmentation révèle parfois des erreurs 404 qui n'apparaissent que sur mobile — dues à des liens qui fonctionnent correctement sur desktop mais qui pointent vers des pages inaccessibles depuis l'interface mobile — un problème spécifique à certaines configurations de CMS qui peut passer inaperçu pendant de longues périodes.

La détection des erreurs 404 nécessite une approche multi-sources — aucun outil seul ne permet d'identifier l'ensemble des erreurs 404 qui affectent un site, parce que leurs origines sont diverses (liens internes, liens externes, URLs orphelines) et parce que leur visibilité varie selon le canal d'accès.

Google Search Console est le premier outil à consulter pour identifier les erreurs 404 signalées par Google. Dans le rapport "Indexation > Pages", le filtre "Page introuvable (404)" liste les URLs que Googlebot a tenté de crawler et qui ont renvoyé une erreur 404. Cette liste est précieuse parce qu'elle correspond exactement aux URLs que Google a tenté d'indexer — des URLs qui ont donc potentiellement une valeur SEO (elles ont été crawlées, elles sont peut-être référencées dans des backlinks ou dans le sitemap) et dont la correction produira un effet direct sur le référencement.

Search Console permet également d'inspecter individuellement chaque URL en erreur pour obtenir des informations sur la date du dernier crawl, le code HTTP retourné, et les URL de référence depuis lesquelles Googlebot a suivi le lien vers cette page en erreur. Cette information sur les URL de référence est particulièrement utile pour identifier les liens internes cassés — en identifiant quelle page du site pointe encore vers l'URL en erreur et en corrigeant ce lien à la source. La surveillance régulière de ce rapport est la pratique de maintenance technique la plus accessible et la plus impactante pour les propriétaires de sites qui ne disposent pas d'outils SEO professionnels.

Les outils de crawl — Screaming Frog en version gratuite pour les sites de moins de 500 URLs, ou ses équivalents professionnels — permettent de simuler le comportement de Googlebot en crawlant l'ensemble du site et en testant chaque lien interne. Le rapport de crawl liste toutes les URLs visitées avec leur code HTTP — permettant d'identifier d'un seul coup d'œil toutes les erreurs 404 générées par les liens internes du site. Cette cartographie est plus complète que celle fournie par Search Console — qui ne liste que les URLs que Googlebot a effectivement crawlées — parce qu'elle inclut les URLs accessibles depuis des liens internes que Googlebot n'aurait pas encore visitées.

L'utilisation d'un outil de crawl est particulièrement recommandée après une refonte ou une modification significative de l'architecture du site — pour s'assurer qu'aucun lien interne n'a été cassé lors des modifications et que le sitemap XML reflète correctement l'ensemble des pages accessibles. Un crawl réalisé dans les jours qui suivent la mise en ligne d'une refonte est la meilleure assurance contre l'accumulation silencieuse d'erreurs 404 qui ne seraient détectées que plusieurs semaines plus tard dans Search Console. L'audit technique SEO en Provence inclut systématiquement ce crawl complet comme étape fondamentale du diagnostic.

La distinction entre les erreurs 404 générées par des liens internes (pages du site qui pointent vers des URLs inexistantes) et celles générées par des liens externes (autres sites ou annuaires qui pointent vers des anciennes URLs du site) est importante pour prioriser les corrections. Les erreurs 404 internes sont les plus urgentes à corriger — parce qu'elles affectent directement la navigation des visiteurs et le crawl de Googlebot sur le site, et parce qu'elles sont entièrement sous le contrôle du propriétaire du site. Les erreurs 404 générées par des liens externes sont moins urgentes mais potentiellement plus impactantes sur le SEO — parce qu'elles signalent que des backlinks de valeur pointent vers des URLs qui ne fonctionnent plus.

La détection des erreurs 404 générées par des liens externes nécessite l'utilisation d'outils d'analyse de backlinks (Ahrefs, Semrush, Moz) qui permettent d'identifier les domaines référents qui font encore des liens vers des URLs disparues du site. Ces outils comparent les backlinks connus avec les URLs actives du site et signalent les liens cassés — en indiquant le domaine source, l'ancre du lien, et l'URL de destination en erreur. Cette information permet de prioriser les redirections 301 à configurer en fonction de la valeur des domaines référents concernés.

La correction des erreurs 404 suit une logique de priorisation — en traitant en premier les erreurs qui ont le plus d'impact sur le trafic et le référencement, et en mettant en place des processus préventifs qui évitent leur réapparition.

La redirection 301 est la solution principale pour corriger les erreurs 404 sur des URLs qui avaient une valeur SEO — parce qu'elle transmet à la page de destination l'autorité accumulée par l'ancienne URL (backlinks reçus, ancienneté d'indexation, signaux d'engagement). La redirection 301 est une redirection permanente — elle indique à Google que la page a définitivement déménagé vers la nouvelle URL, et que tout le capital SEO de l'ancienne URL doit être transféré vers la nouvelle. Cette transmission d'autorité n'est pas instantanée — Google prend quelques semaines à plusieurs mois pour l'intégrer complètement — mais elle est bien plus avantageuse que l'absence de redirection qui conduit à la perte totale de ce capital.

Le choix de la page de destination de la redirection 301 est un facteur critique de son efficacité. La redirection doit pointer vers la page la plus thématiquement proche de la page disparue — et non vers la page d'accueil par défaut, ce qui constitue une erreur fréquente mais sous-optimale. Une redirection d'une ancienne page de service "maçonnerie de prestige" vers la page de service "maçonnerie" générale est plus pertinente qu'une redirection vers la page d'accueil — parce qu'elle préserve la cohérence thématique pour les visiteurs et envoie un signal de pertinence plus fort à Google. Le consultant SEO technique en Provence intervient régulièrement pour prioriser et configurer ces redirections lors des audits post-refonte.

Même avec une gestion rigoureuse des redirections, certaines erreurs 404 sont inévitables — des liens externes qui ne peuvent pas être contrôlés, des URLs mal tapées par des utilisateurs, des liens historiques anciens dont les sources ne sont plus accessibles. Pour ces cas résiduels, une page 404 personnalisée — qui remplace la page d'erreur standard par une page qui guide le visiteur vers des alternatives utiles — est un filet de sécurité qui réduit l'impact de l'erreur sur l'expérience utilisateur.

Une page 404 personnalisée efficace doit contenir : un message clair et non technique qui explique que la page demandée n'existe pas, un lien vers la page d'accueil, des liens vers les pages de service principales ou les sections les plus populaires du site, et éventuellement un moteur de recherche interne. Cette page doit être conçue dans la charte graphique du site — pas dans le style générique des pages d'erreur serveur — pour maintenir la cohérence visuelle et rassurer le visiteur qu'il est bien sur le bon site. Un visiteur qui tombe sur une page 404 bien conçue avec des alternatives claires a une probabilité significativement supérieure de continuer sa navigation par rapport à un visiteur qui tombe sur une page d'erreur serveur standard sans aucune orientation.

La prévention des erreurs 404 repose sur une surveillance régulière — parce que de nouvelles erreurs peuvent apparaître à n'importe quel moment, suite à des modifications du site, à des liens externes qui disparaissent ou changent, ou à des erreurs dans les nouvelles publications de contenu. Une vérification mensuelle du rapport de couverture dans Google Search Console — pour identifier les nouvelles URLs en erreur apparues depuis la dernière vérification — est le minimum indispensable pour maintenir un profil technique sain sur la durée.

Cette surveillance régulière doit être associée à un processus de décision clair pour chaque erreur détectée — en distinguant les erreurs qui méritent une redirection 301 (URLs avec valeur SEO), celles qui peuvent être corrigées à la source (liens internes mal formés), et celles qui peuvent être ignorées (URLs générées par des robots de spam qui tentent d'accéder à des chemins standards non existants). Cette classification évite de traiter toutes les erreurs avec le même niveau d'urgence et permet d'allouer efficacement le temps disponible pour la maintenance technique du site.