Pages zombies : comment identifier et traiter les contenus qui plombent votre SEO

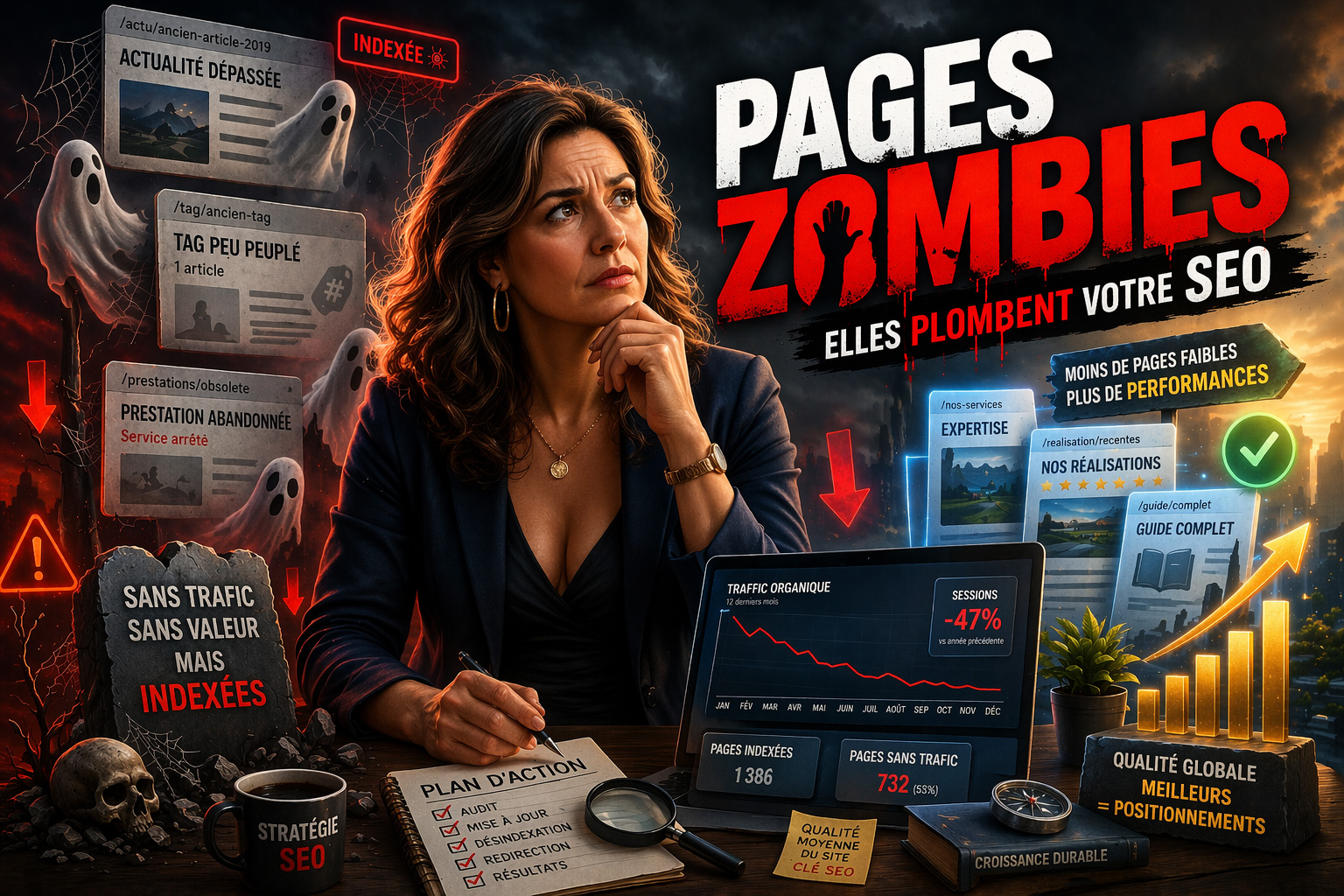

La qualité globale d'un site aux yeux de Google ne se mesure pas uniquement à la qualité de ses meilleures pages — elle se mesure à la qualité moyenne de l'ensemble de ses pages indexées. Cette réalité algorithmique a une implication directe sur la stratégie éditoriale des PME : des pages de mauvaise qualité indexées sur le site ne sont pas neutres pour le référencement — elles peuvent activement nuire au positionnement des bonnes pages, en abaissant la perception générale de la qualité du site par Google. Ces pages de faible qualité qui "zombifient" progressivement le profil d'un site sont désignées dans le vocabulaire SEO par le terme de "pages zombies".

Le concept de pages zombies est particulièrement pertinent pour les sites de PME qui ont plusieurs années d'existence et qui ont publié du contenu de manière régulière sans politique éditoriale structurée de maintenance et de mise à jour. Ces sites accumulent progressivement des pages qui étaient pertinentes lors de leur création mais qui ont perdu leur valeur avec le temps — sans que personne ne les ait identifiées comme problématiques ni pris de décision sur leur sort. L'identification et le traitement de ces pages est l'une des actions d'optimisation SEO les plus impactantes disponibles pour les sites matures dont le trafic stagne ou régresse malgré des efforts de création de nouveau contenu.

La notion de page zombie recouvre une réalité précise qu'il convient de distinguer de concepts voisins — pour cibler correctement les pages qui méritent une action corrective et éviter de traiter des pages qui ne posent pas réellement de problème.

Une page zombie est une page indexée par Google — présente dans son index et susceptible d'apparaître dans les résultats de recherche — mais qui ne génère aucun trafic organique significatif sur une période prolongée, et dont le contenu ne présente pas de valeur ajoutée pour les visiteurs ni pour le référencement du site. Ce sont des pages qui existent dans l'index de Google sans remplir aucune fonction utile — ni informationnelle, ni commerciale, ni de maillage interne. Elles consomment une portion du budget de crawl de Googlebot sans produire de retour SEO, et elles contribuent à abaisser la perception de qualité globale du site.

La caractéristique principale d'une page zombie est la combinaison de l'indexation et de l'inutilité — une page non indexée par définition ne peut pas être une page zombie (elle n'est pas dans l'index), et une page indexée qui génère régulièrement des visites, même modestes, n'est pas nécessairement une page zombie (elle remplit une fonction de visibilité). C'est la coexistence d'une indexation et d'une absence totale d'utilité mesurable qui définit la page zombie et la distingue des autres types de pages problématiques.

Google évalue la qualité d'un site non seulement page par page, mais également de manière globale. Un site dont une proportion élevée de pages indexées présente un contenu de faible qualité — peu de texte, contenu obsolète, aucun engagement des visiteurs, aucune valeur informationnelle — est perçu par Google comme un site dont la qualité globale est insuffisante. Cette perception globale peut affecter le positionnement des bonnes pages du site, même si ces bonnes pages sont individuellement de haute qualité.

Ce mécanisme d'évaluation de la qualité globale d'un site est documenté par Google dans ses guidelines de qualité — les évaluateurs humains qui participent aux processus d'évaluation de la qualité sont invités à évaluer la réputation globale d'un site, pas uniquement la qualité d'une page isolée. Un site dont de nombreuses pages sont de mauvaise qualité verra cette mauvaise réputation globale peser sur le positionnement de l'ensemble de ses pages. Les raisons pour lesquelles Google ignore certaines pages d'un site sont directement liées à cette évaluation de la qualité globale.

Trois concepts sont souvent confondus dans les discussions sur la qualité des pages web — les pages zombies, les pages orphelines et le thin content. Ces concepts se recoupent partiellement mais désignent des réalités distinctes qui nécessitent des traitements différents. Une page orpheline est une page qui n'est liée depuis aucune autre page du site — elle n'est pas accessible depuis la navigation standard et ne reçoit aucun signal de maillage interne. Elle peut ou non être indexée par Google, et elle peut ou non avoir du contenu de qualité. Sa problématique principale est l'isolation dans l'architecture du site.

Le thin content désigne un contenu insuffisamment développé — trop court, trop superficiel, trop générique pour apporter une valeur réelle aux visiteurs. Une page de thin content peut générer du trafic (si elle est bien positionnée sur des requêtes peu compétitives) ou n'en générer aucun — mais sa problématique principale est la pauvreté du contenu lui-même. Une page zombie, elle, est la combinaison des deux : elle est souvent orpheline (peu liée), a souvent du thin content (peu de texte ou contenu obsolète), et ne génère aucun trafic. C'est l'accumulation de ces facteurs qui définit la page zombie — plus que chacun pris séparément. La relation entre cannibalisation SEO et pages de faible qualité est étroite — les deux phénomènes contribuent à la dilution de l'autorité SEO d'un site.

Certains types de pages sont structurellement plus susceptibles de devenir des pages zombies que d'autres — en raison de leur nature, de leur mode de création, ou de leur durée de vie naturelle. Identifier ces types permet de cibler rapidement les zones du site les plus susceptibles de présenter des problèmes.

Les actualités et articles de blog publiés sur un site de PME ont une durée de vie naturelle variable selon leur contenu. Un article sur une réglementation en vigueur, une tendance du marché, ou un événement local publié il y a cinq ans peut être devenu totalement obsolète — la réglementation a changé, la tendance a évolué, l'événement est passé — mais l'article reste indexé et consomme une portion du budget de crawl sans générer de trafic ni de valeur. Ces actualités périmées sont l'une des sources les plus fréquentes de pages zombies sur les sites de PME qui ont eu une activité éditoriale régulière pendant plusieurs années.

La distinction à établir est entre les articles "evergreen" — dont le sujet est suffisamment intemporel pour rester pertinent sur plusieurs années avec une mise à jour légère — et les articles d'actualité dont la pertinence est structurellement liée à une période ou un événement spécifique. Les articles evergreen méritent une mise à jour régulière et doivent être conservés. Les articles d'actualité dont la pertinence est épuisée doivent être traités comme des pages zombies — soit mis à jour substantiellement pour leur redonner une valeur actuelle, soit désindexés ou supprimés avec redirection. Le débat entre fréquence et qualité dans la stratégie de contenu SEO est directement lié à cette accumulation de pages zombies que génère une production éditoriale intensive sans politique de maintenance.

Les CMS modernes — WordPress en particulier — génèrent automatiquement des pages de tags et de catégories pour chaque tag ou catégorie assigné aux articles. Une page de tag qui ne contient qu'un seul article, ou une page de catégorie dont tous les articles ont été supprimés, est une page de contenu minimal qui n'apporte aucune valeur aux visiteurs et qui représente un signal de faible qualité pour Google. Ces pages sont généralement le résultat d'une utilisation non maîtrisée des taxonomies du CMS — tags créés en trop grand nombre, catégories créées sans critères de population minimum.

Le diagnostic est simple : une page de tag ou de catégorie qui liste moins de trois articles ne justifie généralement pas son existence en tant que page indexée. La solution peut être technique (désindexation globale des pages de tags via le fichier robots.txt ou via la configuration du plugin SEO du CMS) ou éditoriale (consolidation des tags en un nombre réduit de taxonomies bien peuplées). Ces pages de taxonomies vides ou peu peuplées représentent souvent une proportion significative des pages zombies d'un site de PME qui a utilisé un CMS comme WordPress sans configurer correctement sa gestion des taxonomies.

Les pages de réalisations qui documentent des projets anciens — dont les photos ne correspondent plus au niveau de qualité actuel de l'entreprise, dont les matériaux ou les techniques présentés sont obsolètes, ou dont le client a depuis cessé son activité — peuvent devenir des pages zombies si elles ne génèrent plus de trafic et si leur contenu ne représente plus avantageusement le savoir-faire actuel de l'entreprise. De même, les pages de prestations que l'entreprise ne propose plus — des services abandonnés suite à une évolution de l'offre ou à une spécialisation progressive — restent parfois indexées pendant des années après l'abandon de la prestation.

Ces pages de réalisations obsolètes et de prestations abandonnées sont particulièrement préjudiciables parce qu'elles envoient un signal SEO contradictoire — elles parlent de services que l'entreprise ne propose plus, avec un vocabulaire et des mots-clés qui ne correspondent plus à la stratégie éditoriale actuelle. Elles peuvent même attirer des prospects qui cherchent des prestations que l'entreprise ne peut pas honorer — générant des contacts non qualifiés et une déception commerciale. La correction passe généralement par la suppression avec redirection vers les pages de prestations actuelles, ou par une mise à jour substantielle qui transforme la page de réalisation obsolète en témoignage actualisé du savoir-faire de l'entreprise.

L'identification des pages zombies nécessite un croisement de données provenant de plusieurs sources — Google Analytics pour le trafic, Search Console pour l'indexation, et des outils de crawl pour la structure du site. Aucune de ces sources seule ne suffit à identifier toutes les pages zombies — c'est leur combinaison qui permet un diagnostic complet.

La première étape du diagnostic est l'analyse du trafic organique par page dans Google Analytics — sur une période suffisamment longue pour neutraliser les effets de saisonnalité et les fluctuations ponctuelles. Une période de douze mois est généralement recommandée. L'objectif est d'identifier les pages qui ont généré zéro ou presque zéro session depuis le trafic organique sur cette période. Ces pages, indexées mais invisibles dans les résultats de recherche, sont les candidates principales au statut de pages zombies.

Dans GA4, ce rapport peut être obtenu depuis le rapport "Pages et écrans" en filtrant uniquement le trafic organique et en triant les pages par volume de sessions croissant. Les pages avec zéro session organique sur douze mois sont affichées en premier et constituent la liste de départ pour l'audit des pages zombies. Cette liste doit ensuite être croisée avec les données d'indexation de Search Console — pour confirmer que ces pages sont bien indexées (et donc potentiellement problématiques) et non simplement non indexées (ce qui serait une situation différente ne nécessitant pas le même traitement).

Google Search Console fournit, via son rapport de couverture, la liste des pages que Google considère comme indexées — avec le détail de leur statut (valide, valide avec avertissement, exclue, erreur). Ce rapport permet de confirmer quelles pages parmi celles identifiées comme sans trafic dans Analytics sont effectivement indexées par Google. La combinaison de ces deux informations — page sans trafic organique + page indexée — est la définition opérationnelle d'une page zombie candidate à un traitement.

Search Console permet également d'inspecter individuellement chaque URL pour obtenir des informations détaillées sur son état d'indexation — date du dernier crawl, version crawlée, données structurées détectées, signaux de qualité. Cette inspection individuelle est particulièrement utile pour les pages dont le statut est ambigu — pages avec des avertissements, pages dont l'indexation a changé récemment. L'audit SEO et diagnostic web en Provence intègre systématiquement ce croisement GA4/Search Console comme composante du diagnostic des pages zombies.

Les outils de crawl — Screaming Frog en version gratuite pour les sites de moins de 500 URLs, ou ses équivalents payants — permettent de crawler l'ensemble du site et d'identifier les pages orphelines — celles qui ne reçoivent aucun lien interne depuis les autres pages du site. Une page orpheline n'est pas nécessairement une page zombie (elle peut générer du trafic depuis des backlinks externes), mais une page qui est à la fois sans trafic organique, indexée, et orpheline est presque certainement une page zombie qui mérite un traitement.

L'analyse du crawl permet également d'identifier les pages avec une profondeur d'arborescence élevée — les pages accessibles uniquement après de nombreux clics depuis la page d'accueil, qui sont structurellement peu susceptibles de recevoir du trafic ou de l'autorité de maillage. Ces pages très profondes dans l'architecture du site sont des candidates fréquentes au statut de pages zombies — leur isolement architectural les prive des signaux de maillage interne qui leur permettraient d'accumuler de l'autorité et de se positionner. L'audit SEO avant refonte de site inclut cette analyse de l'architecture et des pages orphelines comme étape fondamentale.

Une fois les pages zombies identifiées, leur traitement doit être déterminé au cas par cas — selon la valeur résiduelle de chaque page et son potentiel de réhabilitation. Trois options principales sont disponibles, chacune adaptée à un profil spécifique de page zombie.

La mise à jour substantielle d'une page zombie est la solution à privilégier lorsque le sujet de la page reste pertinent pour l'audience cible, que la requête qu'elle cherche à couvrir présente un potentiel de trafic réel, et que la page dispose d'une ancienneté d'indexation et d'éventuels backlinks qui représentent une valeur SEO à préserver. Cette mise à jour ne consiste pas à corriger quelques formulations ou à ajouter un paragraphe — elle consiste à transformer substantiellement la page en un contenu de haute qualité qui répond mieux aux attentes des utilisateurs et aux critères de qualité de Google qu'au moment de sa création.

Une mise à jour efficace d'une page zombie comprend : une réécriture complète ou substantielle du contenu pour le rendre plus complet et plus précis, une mise à jour des informations obsolètes, une restructuration en titres H2 et H3 qui ciblent clairement les requêtes pertinentes, l'ajout de maillage interne depuis et vers la page, et la mise à jour des balises title et méta-description pour les rendre plus attractives dans les résultats de recherche. Après cette mise à jour, la page doit être soumise à l'inspection dans Search Console pour déclencher son recrawl et accélérer la prise en compte des modifications dans l'index de Google.

La désindexation via la balise meta robots "noindex" est la solution appropriée pour les pages zombies dont le sujet n'est plus pertinent, dont la mise à jour substantielle n'est pas justifiée, mais qui doivent rester accessibles aux visiteurs qui y arrivent depuis des liens directs ou des bookmarks. La balise noindex retire la page de l'index de Google — elle ne peut plus apparaître dans les résultats de recherche — sans la supprimer du site. Les visiteurs qui accèdent à la page via son URL directe continuent à la voir normalement.

Cette solution est particulièrement adaptée pour les pages de tags et de catégories peu peuplées — dont la désindexation globale peut être configurée en une seule action depuis le plugin SEO du CMS — et pour les pages d'actualités obsolètes dont le contenu n'a plus de valeur mais qui peuvent avoir reçu des partages sur les réseaux sociaux dont les liens doivent rester fonctionnels. La désindexation via noindex est réversible — si la page est un jour enrichie et redevient pertinente, il suffit de retirer la balise noindex pour la réintégrer dans l'index de Google.

La suppression de la page zombie accompagnée d'une redirection 301 vers une page pertinente du site est la solution la plus radicale — et la plus adaptée lorsque la page n'a aucune valeur résiduelle, n'est jamais visitée directement, et ne mérite pas d'être conservée même de manière non indexée. La redirection 301 transmet l'autorité éventuelle de l'ancienne URL — backlinks reçus, ancienneté d'indexation — vers la page de destination choisie, ce qui préserve une partie de la valeur SEO accumulée.

Le choix de la page de destination de la redirection 301 est important — elle doit être la page du site la plus pertinente thématiquement par rapport à la page supprimée. Une page de réalisation obsolète sur une prestation de maçonnerie doit être redirigée vers la page de service maçonnerie la plus pertinente du site — pas vers la page d'accueil, qui constitue une redirection générique peu valorisée par Google. Cette précision dans le choix de la destination maximise la valeur SEO transmise et améliore l'expérience des visiteurs qui arriveraient sur l'ancienne URL depuis un lien encore actif.

La correction des pages zombies existantes doit s'accompagner de la mise en place d'une politique éditoriale qui prévient leur réapparition. Sans cette politique préventive, le travail de nettoyage devra être répété régulièrement sans jamais régler le problème structurellement.

La règle la plus fondamentale pour prévenir la création de pages zombies est d'établir un critère de qualité minimum pour chaque nouvelle publication — et de ne pas publier une page qui ne répond pas à ce critère, même sous la pression de la régularité éditoriale. Cette règle est contre-intuitive pour les dirigeants qui ont intégré le message "publier régulièrement" comme principe SEO absolu — mais la régularité de publication ne compense pas la faible qualité du contenu publié. Un site qui publie deux articles de haute qualité par mois produit des résultats SEO supérieurs à un site qui publie dix articles de qualité médiocre par mois, parce que les articles de qualité génèrent du trafic, des backlinks et de l'autorité, là où les articles médiocres deviennent des pages zombies.

Le critère de qualité minimum peut être défini simplement : une page ne mérite d'être publiée que si elle répond à une question ou à un besoin précis que les prospects ou clients de l'entreprise expriment réellement, si elle contient un contenu suffisamment développé (généralement au minimum 500 à 800 mots pour un article de blog, davantage pour une page de service) pour traiter le sujet de manière utile, et si elle se différencie suffisamment des pages existantes du site pour ne pas créer de cannibalisation. Ces trois critères, appliqués systématiquement avant toute publication, préviennent la grande majorité des situations qui génèrent des pages zombies.

La prévention des pages zombies passe également par une politique de maintenance des contenus existants — en planifiant des révisions régulières des pages qui ont une durée de pertinence limitée. Cette planification peut être formalisée dans un calendrier éditorial qui réserve une proportion du temps de production de contenu à la mise à jour des pages existantes, plutôt que d'allouer l'intégralité du temps éditorial à la création de nouveaux contenus. Une pratique courante dans les stratégies de contenu SEO matures est d'allouer 30 à 50% du temps éditorial mensuel aux mises à jour de contenus existants et le reste à la création de nouveaux contenus.

La priorisation des mises à jour peut être guidée par les données de Google Search Console — en identifiant les pages qui perdent progressivement des positions ou des clics d'un mois à l'autre, et en les mettant à jour avant qu'elles n'atteignent le stade de page zombie. Une mise à jour préventive d'une page qui commence à perdre du trafic est beaucoup plus efficace qu'une mise à jour curative d'une page qui a déjà complètement perdu ses positions — parce que la page préventive a encore de l'autorité et de l'ancienneté d'indexation qui facilitent sa remontée, là où la page zombie doit repartir presque de zéro. La stratégie de contenus SEO pour une visibilité durable intègre cette logique de maintenance préventive dans son approche globale.

Même avec une politique éditoriale rigoureuse, des pages zombies peuvent apparaître progressivement — suite à une évolution de l'activité de l'entreprise, à un changement dans les comportements de recherche des prospects, ou à une mise à jour algorithmique de Google qui a dégradé les positions de certaines pages sans que cela soit immédiatement détecté. Un audit annuel du parc de pages — qui croise les données de trafic GA4 avec les données d'indexation de Search Console pour identifier les nouvelles pages zombies apparues dans l'année — est le mécanisme de maintenance préventive le plus efficace pour maintenir la qualité globale du site dans la durée.

Cet audit annuel n'est pas nécessairement un exercice long et complexe — pour un site de PME de taille standard (moins de 200 pages), il peut être réalisé en quelques heures avec les bons outils et la bonne méthodologie. L'investissement en temps est rapidement rentabilisé par la préservation de la qualité globale du site et par l'évitement des pertes de trafic que des pages zombies non traitées produiraient progressivement sur l'ensemble du référencement. Une revue annuelle du parc de pages est désormais considérée comme une pratique standard dans toute stratégie SEO mature, au même titre que la production régulière de nouveaux contenus ou le suivi des positions.