Introduction - Mars 2006 : quand tout a commencé

La naissance de l'Agence Easy dans un web en pleine mutation

En mars 2006, le web traverse une période de transformation radicale. Les entreprises commencent tout juste à comprendre qu'un site internet n'est plus une simple vitrine optionnelle, mais devient un canal de communication stratégique. À cette époque, Google consolide sa domination face à Yahoo et MSN Search, le haut débit ADSL se démocratise en France, et les premières versions de WordPress commencent à émerger comme alternative aux sites codés entièrement à la main.

C'est dans ce contexte d'effervescence technologique que l'Agence Easy voit le jour à Saint-Rémy-de-Provence. L'objectif fondateur repose sur une observation simple mais déterminante : la majorité des dirigeants d'entreprises perçoivent le web comme un univers technique complexe, réservé aux grandes structures disposant de budgets conséquents. Cette perception crée une fracture numérique entre les organisations capables d'investir massivement et les PME qui hésitent à franchir le pas, faute de compréhension des enjeux réels et des investissements nécessaires.

Notre vision : accompagner les entreprises dans leur transformation digitale

Dès l'origine, l'approche adoptée se distingue par un postulat : un site internet efficace n'est pas d'abord une question de prouesse technique, mais de compréhension des objectifs métier. Cette vision implique une posture d'accompagnement plutôt que de simple prestation. Concrètement, cela signifie consacrer du temps à analyser le positionnement de l'entreprise, ses cibles, ses contraintes opérationnelles, avant même d'évoquer les aspects techniques ou graphiques.

Cette approche révèle rapidement une constante : les dirigeants sous-estiment systématiquement trois dimensions. D'abord, l'importance du contenu éditorial, souvent traité comme une variable d'ajustement alors qu'il constitue le fondement de toute stratégie de référencement naturel. Ensuite, la nécessité d'une maintenance continue, le web évoluant trop rapidement pour qu'un site puisse rester performant sans adaptation régulière. Enfin, l'impact direct d'un site internet sur la crédibilité perçue de l'entreprise, particulièrement dans les secteurs B2B où un site obsolète ou mal conçu peut disqualifier une organisation avant même tout contact commercial.

2006-2010 - Les années pionnières du web moderne

Le règne de Flash et des sites vitrines animés

Entre 2006 et 2010, Adobe Flash domine la création web. Cette technologie permet des animations sophistiquées, des transitions fluides et des interfaces graphiques impossibles à réaliser avec le HTML et CSS de l'époque. Les sites "full Flash" se multiplient, particulièrement dans les secteurs créatifs, de la mode, du luxe ou de l'événementiel. Macromedia Dreamweaver (racheté par Adobe en 2005) s'impose comme l'outil de référence pour concevoir ces interfaces, tandis que la mise en page repose encore largement sur des tableaux HTML imbriqués, une pratique aujourd'hui considérée comme obsolète.

L'expérience terrain de cette période révèle une tension permanente entre ambition graphique et accessibilité technique. Un site Flash offre une expérience visuelle spectaculaire, mais présente des inconvénients structurels majeurs : temps de chargement prohibitifs pour les connexions bas débit encore répandues, incompatibilité avec les premiers smartphones, et surtout, quasi-invisibilité pour les moteurs de recherche incapables d'indexer le contenu encapsulé dans les fichiers SWF.

Cette dernière limitation est rarement comprise par les décideurs qui privilégient l'impact visuel immédiat sans mesurer les conséquences à moyen terme sur leur visibilité organique. Les premiers sites dynamiques émergent parallèlement, utilisant PHP couplé à des bases de données MySQL. Cette architecture permet enfin de séparer le contenu de la présentation, facilitant les mises à jour sans intervention technique. C'est une révolution conceptuelle pour les entreprises habituées à solliciter leur webmaster pour la moindre modification textuelle.

L'émergence du référencement naturel (SEO)

En 2006, le référencement naturel reste une discipline émergente, largement méconnue des entreprises françaises. Google vient de dépasser définitivement ses concurrents Yahoo et MSN Search (futur Bing) et impose progressivement ses critères de classement. Le concept de PageRank, basé sur l'analyse des liens entrants, structure l'algorithme initial. Cette logique favorise mécaniquement les sites ayant accumulé des backlinks, créant une barrière d'entrée importante pour les nouveaux acteurs.

Les pratiques SEO de cette époque paraissent rudimentaires aujourd'hui : densité de mots-clés calculée mécaniquement, balises meta keywords encore prises en compte, attribution d'une page unique par expression ciblée. Les annuaires web prolifèrent, servant de sources de liens souvent de faible qualité mais statistiquement efficaces. Les premières fermes de liens apparaissent, exploitant les failles algorithmiques avant que Google ne durcisse progressivement ses filtres anti-spam.

L'apparition des premiers systèmes de gestion de contenu (CMS) modifie fondamentalement le marché. SPIP, développé en France, Joomla issu d'un fork de Mambo, et WordPress initialement conçu pour le blogging, démocratisent la création web. WordPress 2.0, sorti en décembre 2005, introduit un éditeur WYSIWYG qui simplifie radicalement la publication de contenu. Cette évolution technique décale progressivement la valeur ajoutée du développeur : moins de code sur mesure, plus de configuration, de personnalisation et d'optimisation de solutions existantes.

Les premiers projets de l'Agence Easy

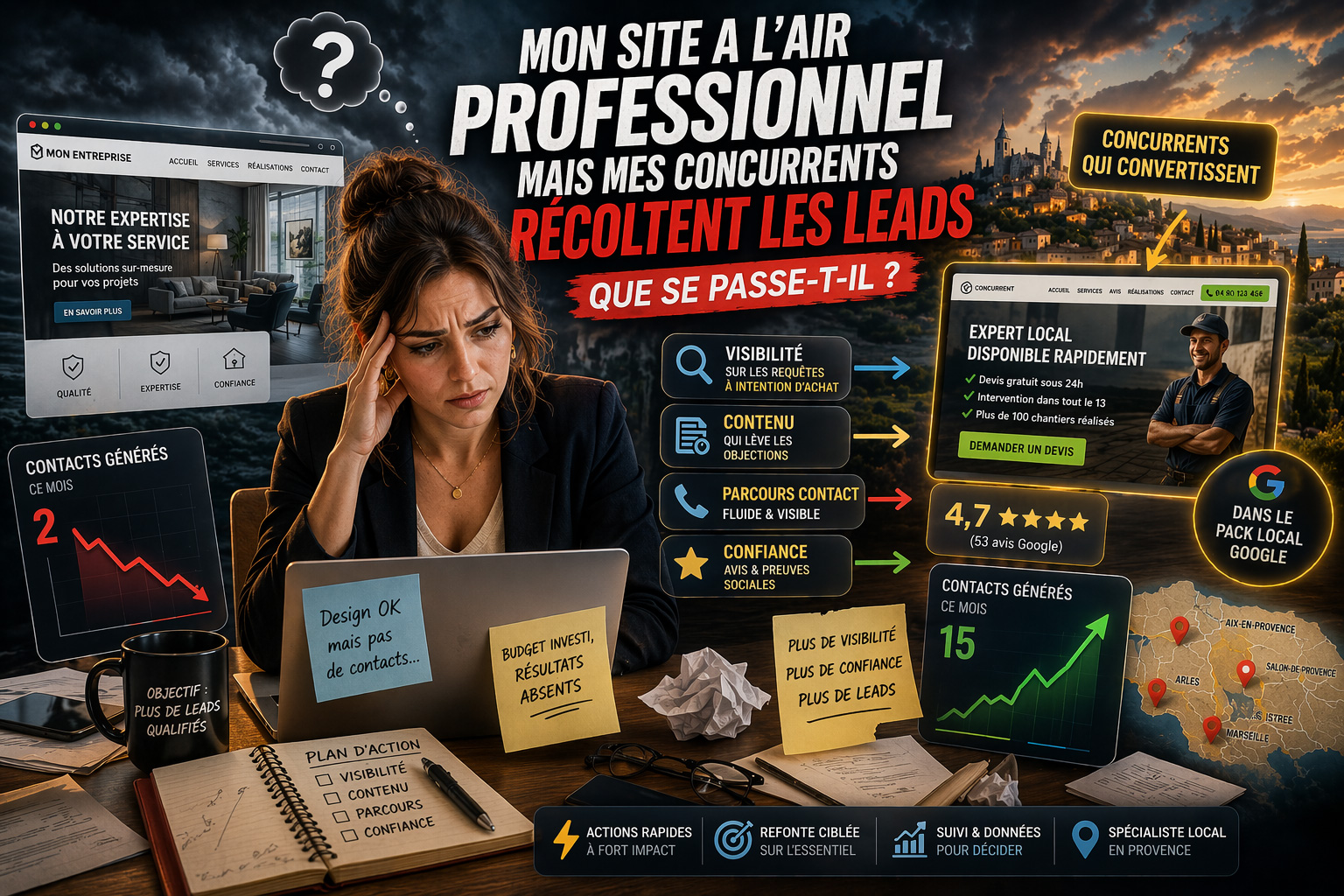

Les premières années d'activité se concentrent sur des sites vitrines pour des TPE et PME locales : artisans, commerçants, professions libérales, petites structures touristiques. La demande exprimée est généralement simple : "avoir un site internet" sans objectif quantifié ni stratégie définie. Cette formulation révèle une méconnaissance des mécanismes numériques : un site sans trafic qualifié ne génère aucun résultat mesurable. Un schéma récurrent émerge rapidement : les clients investissent dans la création du site, puis négligent complètement l'alimentation en contenu et les actions nécessaires pour générer du trafic.

Le site devient alors une carte de visite numérique statique, consultée uniquement par les prospects ayant déjà identifié l'entreprise par d'autres canaux. Cette utilisation minimaliste n'est pas nécessairement négative si elle correspond aux objectifs réels, mais elle sous-exploite systématiquement le potentiel d'acquisition du canal web. Les projets de catalogues produits en ligne constituent la deuxième catégorie de demandes fréquentes. Ces sites, précurseurs des boutiques e-commerce, présentent une offre sans transaction en ligne, le processus d'achat restant traditionnel (téléphone, email, visite en magasin). Cette approche intermédiaire révèle la prudence des entreprises face au paiement en ligne, encore perçu comme risqué par une partie des consommateurs et complexe techniquement pour les commerçants.

2010-2015 - La révolution mobile et responsive

La mort annoncée de Flash et l'avènement du HTML5

En avril 2010, Steve Jobs publie une lettre ouverte expliquant pourquoi Apple refuse d'intégrer Flash sur iPhone et iPad. Les arguments avancés (consommation batterie, instabilité, incompatibilité tactile, contrôle propriétaire d'Adobe) actent la fin d'une ère. Cette décision unilatérale d'un acteur, aussi puissant soit-il, suffit à condamner une technologie dominante. Pour les agences web et leurs clients, les conséquences sont immédiates : tous les sites Flash deviennent invisibles sur les terminaux iOS qui représentent rapidement une part significative du trafic web. HTML5, CSS3 et JavaScript émergent comme le nouveau standard pour créer des interfaces riches.

HTML5 introduit des balises sémantiques (header, nav, article, section) qui structurent mieux le contenu pour les moteurs de recherche, tandis que CSS3 permet enfin des animations, des transitions et des effets visuels sans plugin. JavaScript, longtemps cantonné à des interactions basiques, devient un langage de développement à part entière avec l'émergence de bibliothèques comme jQuery qui simplifient la manipulation du DOM. La transition technique s'avère complexe pour de nombreuses entreprises. Les sites Flash ne peuvent pas être "convertis" facilement : ils doivent être entièrement reconçus selon les nouveaux standards. Cette refonte forcée génère des investissements non anticipés et révèle rétrospectivement le coût caché des choix technologiques non pérennes.

Le responsive design : un site pour tous les écrans

L'explosion des smartphones et tablettes transforme radicalement les usages web. En 2010, moins de 5% du trafic web français provient de mobiles. En 2015, ce chiffre dépasse 30% et continue sa progression. Cette évolution quantitative masque un changement qualitatif plus profond : les contextes de consultation se diversifient, les parcours utilisateurs deviennent multi-devices, les attentes en termes de rapidité et d'ergonomie s'intensifient.

Le concept de responsive design, théorisé par Ethan Marcotte en 2010, propose une réponse technique : un site unique qui s'adapte automatiquement à la taille d'écran grâce aux media queries CSS. Cette approche contraste avec la solution initialement privilégiée par de nombreuses entreprises : créer un site mobile séparé (souvent préfixé par "m.") en complément du site desktop. Le responsive présente plusieurs avantages décisifs : un seul contenu à maintenir, une seule URL à référencer, une cohérence d'expérience garantie quel que soit le terminal. Google formalise cette exigence en 2015 avec l'algorithme "Mobilegeddon" qui pénalise les sites non mobile-friendly dans les résultats de recherche mobile. Ce changement algorithmique majeur concrétise la stratégie "mobile-first" : concevoir d'abord pour le mobile, puis enrichir progressivement l'expérience desktop.

Cette inversion de logique déstabilise les processus de conception traditionnels centrés sur l'écran d'ordinateur. L'observation terrain révèle que de nombreuses entreprises minimisent initialement l'impact du mobile, considérant que leur cible consulte "forcément depuis un ordinateur". Cette hypothèse s'avère systématiquement erronée, y compris dans les secteurs B2B où les décideurs consultent fréquemment depuis leur smartphone, notamment lors de déplacements professionnels ou en dehors des heures de bureau.

WordPress s'impose comme standard du marché

Au début des années 2010, WordPress opère une transition majeure : initialement plateforme de blogging, le CMS devient progressivement un outil de création de sites complets grâce aux custom post types et à l'enrichissement continu de son écosystème. En 2015, WordPress propulse plus de 25% des sites web mondiaux. Cette domination s'explique par plusieurs facteurs convergents : facilité d'installation, interface d'administration intuitive, flexibilité de personnalisation, et surtout, un écosystème gigantesque de thèmes et plugins. Cette abondance présente un revers : la qualité variable des extensions crée des risques de sécurité, de compatibilité et de performance. Un site WordPress mal configuré, surchargé de plugins inutiles ou obsolètes, devient lent, vulnérable et difficile à maintenir.

La compétence requise se déplace alors : il ne s'agit plus de savoir coder un site from scratch, mais de savoir sélectionner, configurer et optimiser les bons outils dans un écosystème pléthorique. L'appropriation de WordPress par les clients constitue un enjeu majeur souvent sous-estimé. La promesse d'autonomie ("vous pourrez modifier vous-même votre site") se heurte à la réalité de la courbe d'apprentissage et du temps nécessaire. Les dirigeants d'entreprise, concentrés sur leur cœur de métier, délèguent finalement la gestion éditoriale ou la négligent, reproduisant les schémas observés précédemment avec les sites statiques.

Les réseaux sociaux transforment la communication digitale

Facebook, Twitter et LinkedIn s'imposent comme canaux de communication complémentaires au site web. Cette évolution crée une confusion stratégique persistante : certaines entreprises considèrent qu'une page Facebook peut remplacer un site internet. Cette vision omet plusieurs dimensions critiques. D'abord, l'absence de maîtrise de la plateforme : les règles d'affichage, les algorithmes de distribution du contenu, les conditions d'utilisation évoluent sans concertation avec les utilisateurs.

Ensuite, la dépendance totale à un tiers pour l'accès aux données et contacts. Enfin, les limitations fonctionnelles pour des opérations e-commerce complexes ou la présentation structurée d'une offre professionnelle. L'approche pertinente consiste à concevoir le site web comme hub central de la présence numérique, les réseaux sociaux servant de relais pour générer du trafic qualifié. Cette logique impose une cohérence éditoriale cross-canal et une stratégie de contenu adaptée aux spécificités de chaque plateforme.

Le community management émerge comme nouvelle compétence, combinant rédaction, relation client, veille et analyse. Les entreprises découvrent progressivement que l'animation efficace d'une présence sur les réseaux sociaux requiert un investissement temps significatif, rarement anticipé lors du lancement des pages.

2015-2020 - L'ère de l'expérience utilisateur et de l'e-commerce

UX/UI Design : l'utilisateur au centre de tout

La période 2015-2020 marque l'affirmation de l'UX (User Experience) et de l'UI (User Interface) comme disciplines structurantes de la conception web. Les tendances visuelles évoluent rapidement : Material Design introduit par Google en 2014 impose une grammaire visuelle cohérente, le Flat Design remplace les effets de relief hérités du skeuomorphisme, la typographie devient un élément central de l'identité visuelle numérique.

Au-delà des aspects graphiques, l'UX design repose sur une méthodologie d'analyse des parcours utilisateurs. Cette approche implique d'identifier les personas représentant les différentes typologies de visiteurs, de cartographier leurs parcours, d'identifier les points de friction, puis d'optimiser chaque étape pour faciliter la conversion vers l'objectif visé (achat, demande de contact, téléchargement, inscription).

Les tests utilisateurs, l'A/B testing et l'analyse des heatmaps deviennent des pratiques courantes pour les organisations matures. L'observation terrain révèle que cette approche méthodologique reste minoritaire, particulièrement dans les PME. La majorité des sites sont encore conçus selon une logique d'organisation interne de l'entreprise plutôt que selon les besoins réels des utilisateurs. Cette inversion de perspective constitue pourtant un levier d'optimisation majeur : un site structuré selon la logique client génère systématiquement de meilleures performances qu'un site reflétant l'organigramme de l'entreprise.

Google Core Web Vitals et performance web

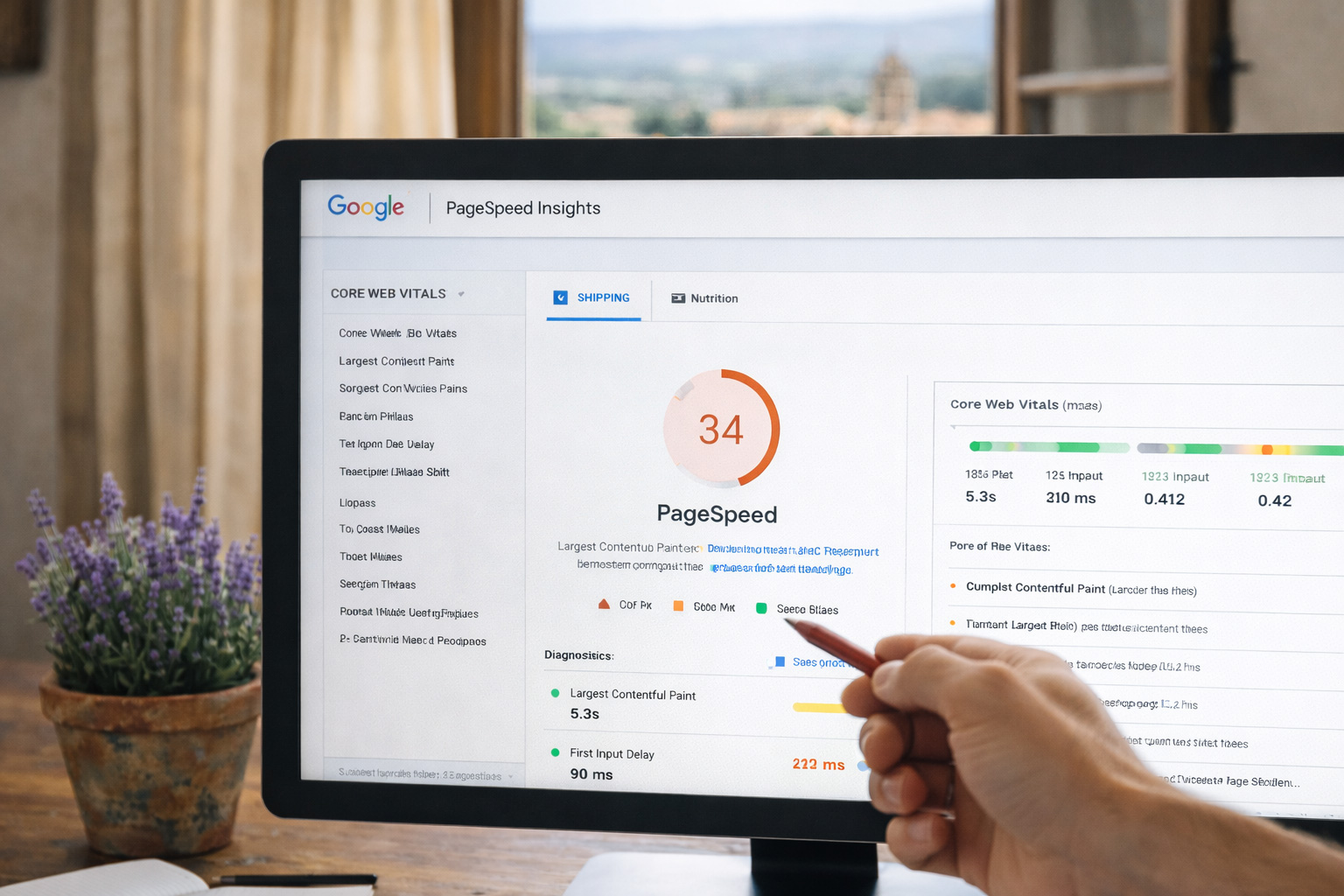

En 2018, Google introduit la "Speed Update" qui intègre officiellement la vitesse de chargement mobile comme facteur de classement. Cette décision acte l'importance de la performance technique dans le référencement. Les Core Web Vitals, annoncés en 2020 et déployés en 2021, raffinent cette exigence en définissant trois métriques précises : LCP (Largest Contentful Paint) mesure la vitesse d'affichage du contenu principal, FID (First Input Delay) évalue la réactivité aux interactions utilisateur, CLS (Cumulative Layout Shift) quantifie la stabilité visuelle pendant le chargement. Ces indicateurs techniques reflètent une réalité comportementale : les utilisateurs abandonnent massivement les sites lents. Les études de Google montrent qu'une seconde supplémentaire de temps de chargement peut réduire les conversions de 20%.

Pour les sites e-commerce, l'impact est directement mesurable en chiffre d'affaires perdu. L'optimisation de la performance implique des arbitrages techniques complexes : compression et lazy loading des images, minification du code CSS et JavaScript, mise en cache agressive, utilisation d'un CDN (Content Delivery Network), optimisation des requêtes base de données. Ces aspects techniques sont rarement maîtrisés par les clients et nécessitent une expertise spécialisée. Un site WordPress mal optimisé peut présenter des temps de chargement supérieurs à 5 secondes là où une configuration optimale atteint moins d'une seconde sur le même contenu.

L'explosion de l'e-commerce et des solutions marchandes

Le e-commerce connaît une croissance exponentielle entre 2015 et 2020. WooCommerce, extension WordPress, devient la solution la plus déployée mondialement grâce à sa facilité d'intégration. PrestaShop domine le marché français des solutions open source dédiées. Shopify s'impose comme référence des solutions SaaS (Software as a Service) proposant une infrastructure complète sans gestion technique serveur.

Ces plateformes démocratisent le commerce en ligne mais ne suppriment pas la complexité intrinsèque de l'activité. Un projet e-commerce performant nécessite de structurer un catalogue produit avec des fiches détaillées, d'optimiser le tunnel de conversion, d'intégrer les solutions de paiement sécurisé, de configurer les modules de livraison, de mettre en place la gestion des stocks, et de gérer l'après-vente.

Cette chaîne opérationnelle dépasse largement la dimension technique du site. L'expérience accumulée révèle que l'échec des projets e-commerce provient rarement de défaillances techniques, mais de lacunes dans la préparation : catalogue produit incomplet, photos de qualité insuffisante, descriptions standardisées sans différenciation, absence de stratégie d'acquisition de trafic, sous-estimation des contraintes logistiques. Le site e-commerce n'est qu'un maillon d'un dispositif commercial complet qui doit être pensé globalement.

RGPD : la protection des données au cœur du web

Le Règlement Général sur la Protection des Données (RGPD) entre en application le 25 mai 2018, imposant de nouvelles obligations à toute organisation traitant des données personnelles de résidents européens.

Les implications pour les sites web sont multiples : obligation d'obtenir un consentement explicite avant le dépôt de cookies non essentiels, mise en place de mentions d'information claires, garantie du droit d'accès et de suppression des données, sécurisation renforcée des bases de données. Cette évolution réglementaire bouleverse les pratiques établies. Les outils de tracking analytics, de remarketing publicitaire, les formulaires de contact, les newsletters nécessitent désormais des mécanismes de consentement conformes. Les bandeaux cookies prolifèrent sur tous les sites, souvent mal configurés et source de friction dans le parcours utilisateur.

Au-delà de la conformité légale, le RGPD impose une réflexion stratégique sur la collecte de données : quelles données sont réellement nécessaires ? Comment les sécuriser ? Combien de temps les conserver ? Cette approche par le privacy by design (protection de la vie privée dès la conception) constitue une opportunité de différenciation pour les organisations qui en font un argument de confiance plutôt qu'une contrainte.

2020-2026 - Intelligence artificielle et web augmenté

La pandémie accélère la digitalisation

La crise sanitaire de 2020 provoque une accélération brutale de la digitalisation. Du jour au lendemain, des entreprises qui fonctionnaient exclusivement sur des modèles traditionnels doivent basculer vers le e-commerce, le télétravail, la visioconférence. Cette transition forcée révèle le niveau de maturité numérique réel des organisations : celles ayant anticipé ces évolutions s'adaptent rapidement, les autres subissent une transformation douloureuse sous contrainte.

Les demandes de création de sites e-commerce explosent, portées par des commerces de proximité contraints de fermer physiquement. Les délais se tendent, les prestataires saturent. Cette urgence conduit parfois à des choix précipités : solutions inadaptées, déploiements bâclés, absence de stratégie d'acquisition. Le constat est sans appel : un site e-commerce créé dans l'urgence sans préparation génère rarement les résultats espérés.

Parallèlement, les outils de collaboration en ligne (visioconférence, partage de documents, gestion de projet) s'imposent définitivement dans les pratiques professionnelles. Cette évolution modifie également les modalités d'accompagnement des clients : les réunions à distance deviennent la norme, facilitant paradoxalement la collaboration avec des prestataires distants géographiquement.

L'intelligence artificielle transforme la création web

Le lancement de ChatGPT en novembre 2022 marque une rupture dans l'accessibilité de l'intelligence artificielle générative. En quelques mois, les outils d'IA se multiplient : génération de textes, création d'images, assistance au code, production vidéo, synthèse vocale.

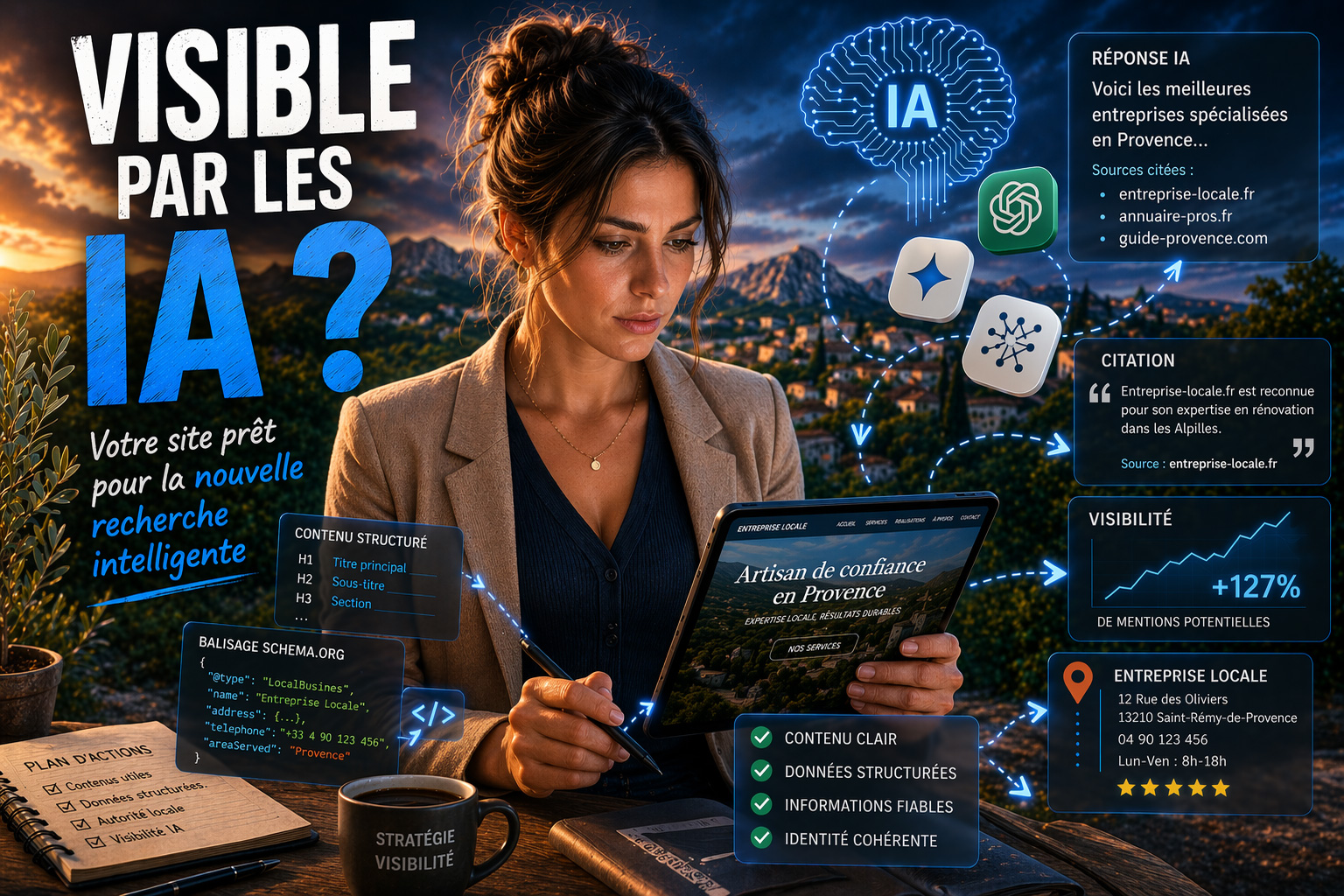

Pour le secteur web, les implications sont considérables et encore en cours de définition. L'IA générative devient un outil d'assistance à la rédaction de contenu, permettant d'accélérer la production éditoriale. Néanmoins, cette efficacité apparente masque un risque majeur : la banalisation du contenu. Si toutes les entreprises d'un secteur utilisent les mêmes outils pour générer leurs textes, le web se remplit de contenus similaires, standardisés, dépourvus de personnalité et de valeur ajoutée distinctive. Google adapte d'ailleurs progressivement ses algorithmes pour détecter et dévaloriser ces contenus génériques.

Les assistants virtuels et chatbots intelligents se perfectionnent, offrant des capacités de support client automatisé de plus en plus convaincantes. Ces outils peuvent traiter les demandes fréquentes, orienter les visiteurs, qualifier les prospects, libérant ainsi du temps pour les interactions à forte valeur ajoutée. L'enjeu consiste à calibrer correctement le niveau d'automatisation sans déshumaniser totalement la relation client.

L'intégration de l'IA dans les processus de création web soulève également des questions éthiques et juridiques : propriété intellectuelle des contenus générés, biais algorithmiques, transparence sur l'utilisation de l'IA, impact sur l'emploi dans les métiers de la création. Ces interrogations sont loin d'être résolues et structureront probablement les évolutions réglementaires des prochaines années.

Accessibilité et éco-conception : les nouveaux impératifs

L'accessibilité numérique, encadrée en France par le RGAA (Référentiel Général d'Amélioration de l'Accessibilité) et au niveau international par les WCAG (Web Content Accessibility Guidelines), impose de concevoir des sites utilisables par tous, y compris les personnes en situation de handicap. Cette exigence n'est plus seulement morale mais devient progressivement légale : depuis 2019, les sites publics et certaines entreprises privées sont soumis à des obligations de conformité sous peine de sanctions. Au-delà de l'aspect réglementaire, l'accessibilité élargit mécaniquement l'audience potentielle.

Un site accessible bénéficie également à des situations de handicap temporaire (bras cassé, environnement bruyant) ou contextuel (consultation en plein soleil réduisant la lisibilité). Les bonnes pratiques d'accessibilité (contraste suffisant, structure sémantique, alternatives textuelles aux images) améliorent aussi le référencement naturel et l'expérience globale de tous les utilisateurs. L'éco-conception web émerge parallèlement comme réponse à l'empreinte environnementale croissante du numérique. Un site éco-conçu minimise son impact en optimisant le poids des pages, en limitant les ressources serveur nécessaires, en évitant les fonctionnalités superflues. Cette démarche converge avec les objectifs de performance : un site léger est simultanément plus rapide, moins énergivore et moins coûteux à héberger.

Ces deux dimensions (accessibilité et éco-conception) partagent une caractéristique : elles nécessitent d'être intégrées dès la phase de conception. Les corriger a posteriori sur un site existant s'avère toujours plus complexe et coûteux qu'une prise en compte native.

JAMstack, headless CMS et nouvelles architectures

L'architecture JAMstack (JavaScript, APIs, Markup) propose une approche radicalement différente de la conception web traditionnelle. Plutôt que de générer dynamiquement les pages à chaque requête utilisateur, le site est pré-généré en fichiers statiques lors du déploiement.

Cette méthode offre des performances exceptionnelles, une sécurité renforcée (absence de base de données exposée) et une scalabilité naturelle. Les headless CMS complètent cette évolution en séparant totalement la gestion du contenu (back-end) de sa présentation (front-end). Cette architecture découplée permet de distribuer le même contenu sur différents canaux (site web, application mobile, objets connectés) depuis une source unique.

Pour les organisations multi-canal, cette approche simplifie considérablement la gestion éditoriale. Ces évolutions architecturales requièrent néanmoins des compétences techniques avancées, particulièrement en développement JavaScript moderne (React, Vue.js, Next.js). Elles conviennent prioritairement aux projets d'envergure justifiant cet investissement technologique. Pour la majorité des sites vitrines ou e-commerce de TPE/PME, les CMS traditionnels optimisés restent parfaitement pertinents et plus accessibles.

2026 et au-delà - Notre vision pour les 20 prochaines années

Les tendances qui façonnent l'avenir du web

Le Web3, construit sur les technologies blockchain, promet une décentralisation radicale : propriété vérifiable des actifs numériques, transactions peer-to-peer sans intermédiaire, identité numérique portable. Ces concepts séduisent par leur dimension philosophique mais peinent encore à démontrer des cas d'usage grand public convaincants au-delà de la spéculation sur les cryptomonnaies et NFT.

L'évolution réglementaire de ces technologies déterminera largement leur adoption future. Le métavers, malgré les investissements massifs de certains acteurs technologiques, reste un concept flou oscillant entre réalité virtuelle immersive et espaces 3D interactifs. Les applications professionnelles (formation, visualisation produit, événementiel) semblent plus matures que les usages grand public encore limités par les contraintes matérielles et l'ergonomie des casques VR. La réalité augmentée, intégrant des éléments numériques dans l'environnement réel via smartphone ou lunettes connectées, présente des applications concrètes : visualisation de meubles avant achat, aide à la navigation, maintenance industrielle assistée. Cette technologie pourrait modifier significativement l'e-commerce en réduisant l'écart entre expérience physique et numérique.

L'intelligence artificielle continuera son intégration progressive dans tous les aspects du web. La personnalisation poussée des expériences utilisateur, l'anticipation des besoins, l'automatisation des tâches répétitives deviendront standards. Le défi consistera à préserver l'authenticité et l'humanité des interactions dans un environnement de plus en plus automatisé. La recherche vocale et les interfaces conversationnelles transforment déjà les modalités d'accès à l'information. L'optimisation SEO devra s'adapter à ces nouveaux usages où les requêtes prennent une forme naturelle et conversationnelle plutôt que des mots-clés juxtaposés.

L'Agence Easy en 2026 : notre positionnement

Après vingt années d'observation des transformations numériques, plusieurs convictions structurent l'approche développée. D'abord, la technologie reste un moyen, jamais une fin en soi. Les organisations performantes ne sont pas celles qui adoptent systématiquement les dernières innovations, mais celles qui sélectionnent les outils adaptés à leurs objectifs réels et à leurs contraintes opérationnelles.

Ensuite, la durabilité d'une présence web repose sur trois piliers indissociables : une stratégie claire définissant des objectifs mesurables, du contenu de qualité régulièrement actualisé, et une maintenance technique continue. Négliger l'un de ces trois axes compromet inévitablement les résultats à moyen terme. Enfin, l'accompagnement efficace implique une posture pédagogique : expliquer les enjeux, rendre compréhensibles les contraintes techniques, former les équipes internes, transférer progressivement les compétences. L'autonomie du client sur les aspects opérationnels de son site constitue un objectif souhaitable, même si elle nécessite un investissement initial en formation souvent sous-estimé.

L'équipe réunit aujourd'hui des compétences complémentaires couvrant l'ensemble de la chaîne de valeur : conseil stratégique, conception UX/UI, développement web, référencement naturel, maintenance et hébergement. Cette polyvalence permet d'intervenir aussi bien sur des projets complets que sur des missions spécifiques d'optimisation ou d'audit.

Merci à nos clients et partenaires

Ces vingt années d'activité se sont construites grâce à la confiance accordée par des centaines d'entreprises de toutes tailles et de tous secteurs. Certaines collaborations perdurent depuis les premières années, évoluant au rythme des transformations technologiques et des développements de l'activité. Ces relations durables constituent la validation la plus tangible de la pertinence de l'approche privilégiée.

Les projets marquants ne sont pas nécessairement les plus complexes techniquement ou les plus volumineux financièrement. Ce sont souvent ceux où l'impact business a été le plus mesurable : une TPE artisanale qui triple son chiffre d'affaires grâce à une visibilité web optimisée, un commerce de proximité qui survit à une crise en basculant vers le e-commerce, une PME industrielle qui structure sa génération de leads B2B grâce à une stratégie de contenu pertinente.

Les partenariats noués avec d'autres acteurs du digital (graphistes, photographes, rédacteurs, consultants marketing) enrichissent l'offre en permettant de mobiliser les expertises spécifiques requises par certains projets sans diluer les compétences cœur. Cette approche collaborative évite l'écueil de la surspécialisation comme celui de la dispersion.

Conclusion - 20 ans d'expertise à votre service

Ces deux décennies d'évolution du web révèlent une constante : la vitesse de transformation technologique s'accélère continuellement. Les cycles d'adoption et d'obsolescence se raccourcissent, obligeant les organisations à une veille permanente et à une capacité d'adaptation constante. Dans ce contexte mouvant, l'expérience accumulée constitue un actif stratégique : elle permet d'identifier les tendances structurantes parmi le bruit ambiant, de distinguer les innovations véritablement disruptives des effets de mode temporaires, d'anticiper les implications à moyen terme de choix techniques actuels.

La création d'un site internet performant en 2026 mobilise simultanément des compétences techniques pointues, une compréhension fine des mécanismes de référencement, une sensibilité au design et à l'expérience utilisateur, une maîtrise des contraintes légales, et surtout une capacité à traduire des objectifs business en spécifications fonctionnelles cohérentes. Cette pluralité d'expertises requises explique pourquoi l'accompagnement par des professionnels expérimentés génère systématiquement de meilleurs résultats que les approches autodidactes ou les solutions standardisées low-cost. Les vingt prochaines années apporteront certainement leur lot d'innovations, de ruptures technologiques et de nouveaux paradigmes.

La capacité à naviguer ces transformations futures reposera sur les mêmes fondamentaux : clarté stratégique, rigueur d'exécution, capacité d'adaptation, et attention constante aux besoins réels des utilisateurs finaux. L'expérience acquise depuis 2006 constitue le socle à partir duquel ces défis futurs pourront être relevés efficacement. Pour les dirigeants d'entreprise confrontés à ces enjeux numériques, la question n'est plus de savoir s'il faut investir dans une présence web professionnelle, mais comment le faire de manière stratégique, pérenne et alignée avec les objectifs opérationnels.

La réponse à cette question nécessite un diagnostic précis de la situation actuelle, une définition claire des objectifs visés, et une feuille de route adaptée aux ressources disponibles. C'est précisément dans cet accompagnement stratégique et opérationnel que vingt ans d'expérience terrain trouvent leur pleine valeur.